Depuis deux ans, l’IA générative s’est imposée comme l’un des principaux catalyseurs de transformation technologique dans les entreprises.

L’apparition de modèles comme Chat GPT a profondément modifié la manière dont les organisations envisagent l’intelligence artificielle. Là où les projets d’IA étaient autrefois limités à des cas d’usage analytiques ou prédictifs, ils s’intègrent désormais directement dans les processus métiers.

Copilotes pour les collaborateurs, assistants documentaires, automatisation du service client : l’IA générative transforme progressivement l’expérience de travail.

Mais cette évolution révèle également une réalité souvent sous-estimée : le véritable défi n’est plus seulement le modèle, mais l’architecture qui permet de l’exploiter efficacement — et en toute sécurité, en contexte d’entreprise.

De l’entraînement de modèles à l’architecture de systèmes

Pendant plus d’une décennie, les projets d’IA ont été dominés par une approche centrée sur les modèles.

Les équipes data entraînaient des algorithmes à partir de données pour résoudre des problèmes spécifiques.

Avec les grands modèles de langage, cette logique change radicalement.

Les entreprises ne développent plus nécessairement leurs propres modèles. Elles s’appuient sur des plateformes existantes, comme Azure Open AI Service, pour accéder à des capacités d’IA avancées.

Le cœur du problème devient alors architectural : comment intégrer ces modèles dans les systèmes d’information existants ?

L’architecture LLM : un nouveau terrain d’ingénierie

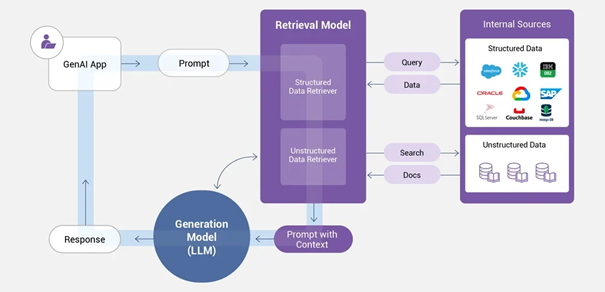

Les systèmes d’IA générative reposent sur une combinaison de composants technologiques :

- modèles de langage comme GPT-4, Claude, Mistral…

- bases vectorielles pour la recherche sémantique (Azure AI Search, Q drant, pg vector…)

- architectures RAG permettant de connecter l’IA aux données internes

- frameworks d’orchestration comme Lang Chain, Semantic Kernel…

- couches de sécurité, de gouvernance et de gestion multi-tenant

Ces briques doivent être intégrées dans des applications fiables, sécurisées et capables de fonctionner à grande échelle.

Cette complexité explique l’émergence d’un nouveau rôle dans les équipes techniques : l’ingénieur spécialisé dans les architectures LLM.

Un profil hybride encore rare

Ce nouvel ingénieur se situe à la croisée de plusieurs disciplines :

- architecture logicielle

- cloud computing

- data engineering

- intelligence artificielle

Contrairement aux profils traditionnels de machine learning, son rôle ne consiste pas à entraîner des modèles, mais à concevoir et orchestrer des systèmes d’IA générative complets, en tenant compte des contraintes réelles de l’entreprise : sécurité, multi-tenancy, observabilité, intégration avec les systèmes existants.

Cette hybridation explique pourquoi ces profils restent encore relativement rares sur le marché.

L’enjeu stratégique des architectures GenAI

À mesure que les entreprises déploient des copilotes et des assistants intelligents, les architectures LLM deviennent une composante essentielle des systèmes d’information.

Les organisations qui réussiront à industrialiser ces architectures disposeront d’un avantage compétitif important : une capacité accrue à exploiter leur capital informationnel et à automatiser des tâches à forte valeur ajoutée.

Dans ce contexte, l’ingénierie des systèmes d’IA générative s’impose progressivement comme une nouvelle discipline stratégique du software engineering — et un profil clé pour les équipes techniques de demain.